很多人在買到相機的一開始,都會有這個問題:「我要選哪種影片格式」,對於職業攝影師來說應該是老生常談了。但對於新手來說應該還是一知半解、一頭霧水……

今天快速跟大家分享一下:現今各家相機,在拍攝影片時的主流格式,以及他們的優缺點。

容器&編碼器

說到格式,很多人直覺就會說:是不是就是那個檔名後面的什麼.mp4或是.mov,那「格式」這兩個字的定義呢,對於「影片」來說,其實也是有點「籠統」。我們用另外兩個名詞來傳達,可能會比較明確。

第一個叫作「容器」,像是mp4、mov這個就是所謂的檔案容器,它就是一個外殼封裝的概念。

那即使是使用了相同的容器,裡面的編碼器只要不同,結果可能就會天差地。這就是為什麼前面說用副檔名來判斷影像格式,現在來說是不太精確的說法。

當然,不同的容器有時也會有不同特性,但通常不用太在意功能性的區別。最簡單的方式,就是看你的電腦是什麼作業系統,windows選mp4,mac選mov,也就是原生支援最好。

上面說的是在電腦上使用的情況,回到相機上,你該選哪種容器? 這兩者可能都會有不同的功能限制,要稍微注意一下,像是Nikon的Z系列你要使用時間碼就只必須選擇.mov。不過,如果你的相機或攝影機沒有給你選檔案容器,那反而是好事,大可忽略,因為代表容器在該機型上不會影響到功能的表現。

說完了容器,接下來講一下關鍵的內在:編碼器。

編碼器之一:第一個征服天下的H.264

過去十年間,自從HD普遍以來,最成功的影片格式,非H.264莫屬了,又稱Mpeg-4 AVC或是Long GOP,屬當今最容易被播放、被解碼的影片,壓縮效果不錯、品質也都還OK。

那原本想先講MPEG是怎麼樣陪著我長大的,但因為有點離題,所以有興趣的可以聽到最後,尤其年過三十的,應該都會有感觸。

幾乎你現在打得開的智慧裝置、任何作業系統,都支援了H.264的影片播放,就連你在YT的影片也都是採用H264編碼。

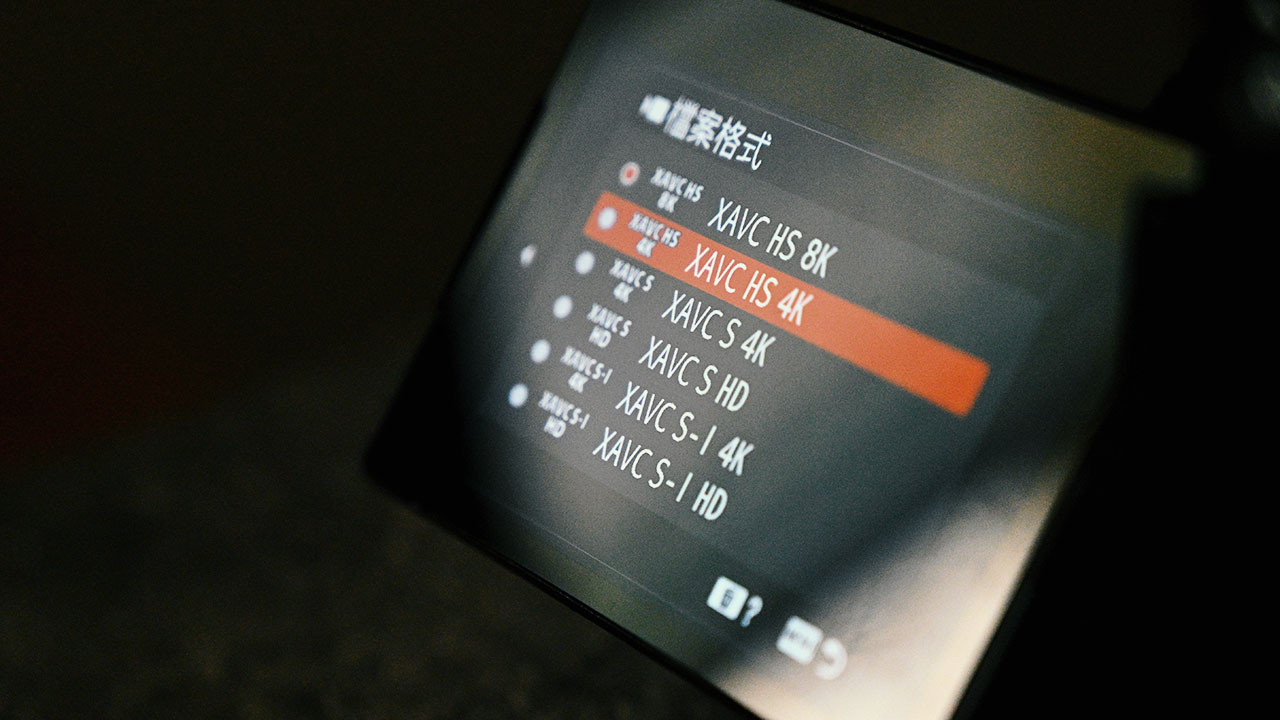

H.264 在SONY的機器上,你只要看到「XAVC S」那就是。Canon的相機沒有讓你選,目前是會使用在比較低階的檔案格式。Nikon的相機呢,目前大多仍是自動採用H.264編碼。

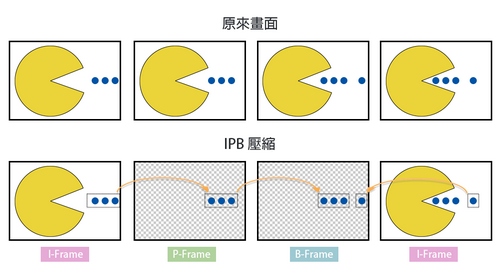

h264預設為幀間壓縮,Canon的相機上你會看到有一個「IPB」的選項,那就是幀間壓縮。什麼是幀間壓縮呢? 就是編碼器會去判斷當前影格有哪些部份是和上一幀或前幾幀一樣,它就會直接沿用,也就是偷工減料。通常會發生在靜態的背景,比如你現在看到的藍色區域,如果都是拍攝固定式的坐談,那不太可能會有明顯的失真,但如果畫面中有很多粒子、或是變化劇烈,那碼率不夠高時就會容易有馬賽克。

碼率

好,這個碼率是什麼呢? 你常會聽到「破壞性壓縮」,它在壓縮的過程中,畫質是被破壞的,那破壞的程度呢,就取決於碼率,或稱壓縮率、檔案的流量。比如100Mbps、200Mbps,這個數字越高檔案越大、保存的細節越多、畫質也越好。

通常相機上會顯示Mbps,這裡指的是Megabit per second,很多人看到100Mbps就以為錄影一秒會有100MB的檔案,但其實這是錯誤的。

Mbps的「b」是小寫,小寫通常代表的就是bit-位元,大寫的B就是byte位元組,而8個bit才會是一個byte-位元組,也就是說100Mbps要除以8才會是12MB/s,也就是一秒會產生12MB左右的檔案,所以最快的方式就是看到Mbps直接除以8。

如果你對這種檔案流量、壓縮率沒有概念,到這個網站你可以輸入碼率和錄製的時長,它就會告訴你檔案大概會有多大。

像素採樣與色彩深度

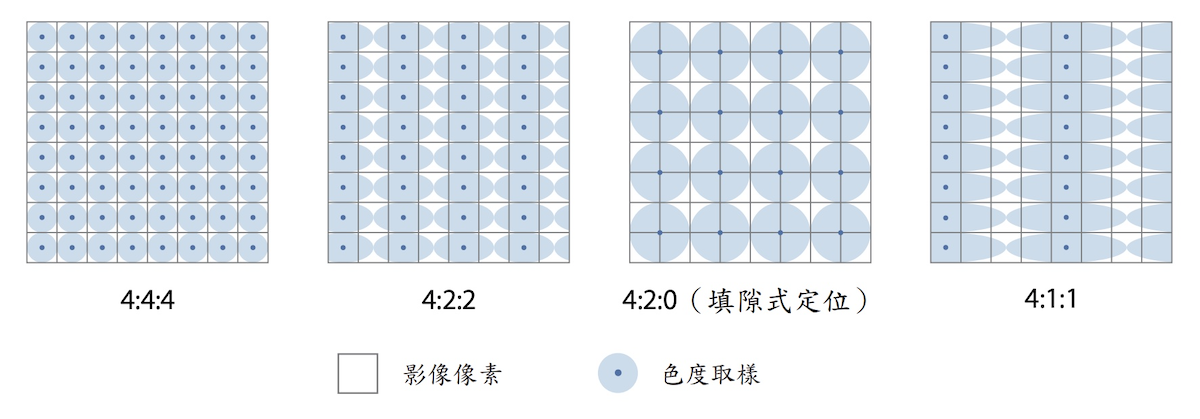

那如果你的相機比較新、比較強,可能還會看到4:2:0、4:2:2的選項。422的像素會更細膩,這個通常是在綠幕去背的時候優勢才會明顯,但檔案流量也會比420的高。

而8-bit和10-bit則是色彩的深度,10-bit同樣會需要高的流量來儲存,那這個主要是會在後期重度調色時才會感受差異,你拍攝時你並不會感受到8-bit色彩不鮮艷的問題。Sony的相機可以額外去細部選擇採樣和色彩。如果是Canon的相機呢,會在啟用Log色彩拍攝時自動採用422採樣和10-Bit色彩。

就現階段而言,尤其是大多作品都在網路呈現的時代,提高採樣率和色彩位元的主要效益在於「提高素材後製的可塑性」,讓你的天空在調色的時候不容易斷階、去背的時候髮絲不容易結塊。

但你如果你不調色、沒有去背的需求、影片也只是放網路,那以結果論來說:使用較高的採樣和色彩深度,當下獲得的感受可能不會那麼顯著。相反的,如果你重視後製調光調色、又有特效合成的需求,最後還要在家裡用你的HDR電視欣賞自己的大作,那這些規格肯定還是開好開滿。

又或者,如果「儲存成本高」對你來說並不是什麼需要擔心的問題,那全數採取最高規格紀錄,別人也不能說什麼。

編碼器之二:下個時代的主流H.265/HEVC

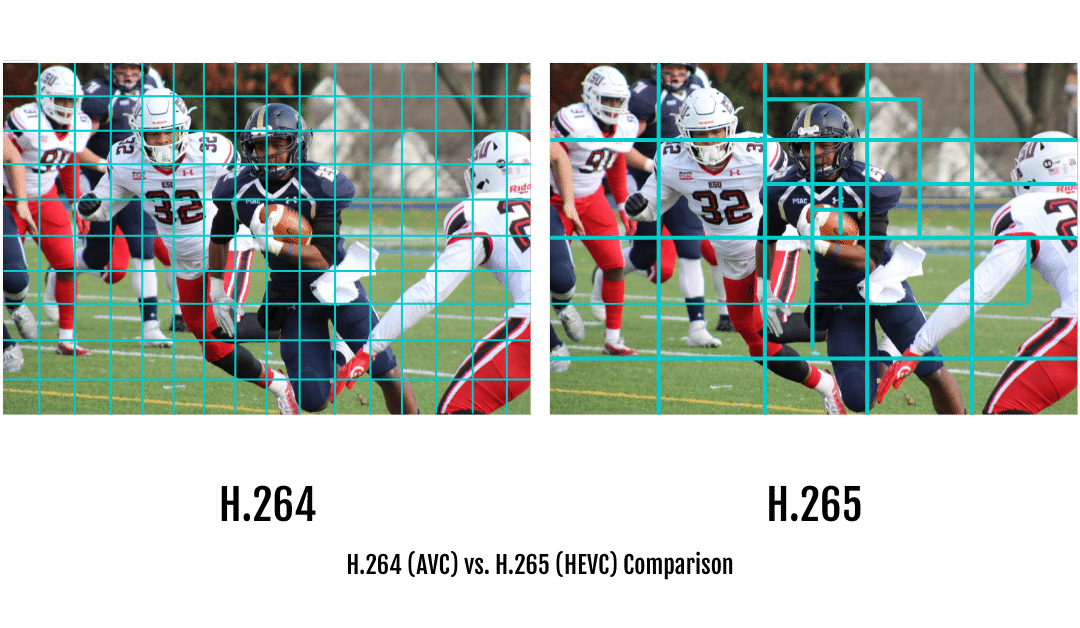

到H.265,又稱HEVC,也就是近年開始普遍的編碼器,沒有意外的話,也會是下一個統一市場的規格,或者說它已經在統一了。

容器和H.264也一樣,可以是mp4也可以是mov。

那Panasonic算是最早一批上了車的,GH5上市時就已經搭載此編碼器,SONY近幾年出的相機裡的XAVC HS就是H.265的格式,那像是Canon新的機型你只要使用Canon Log就會自動使用H.265的編碼器,算是比較果斷的做法。

反倒是Nikon這個大廠,不知為何還沒有醒,目前只在一般人遙不可及Z 9上有出現了H.265,整體產品的動態攝影性能,升級的速度慢了不少。

現在只要是支援8K錄影的相機,也都會是採用H.265來紀錄8K,因為H.264的壓縮效率、規格已經不符合這個等級的需求了。

雖然H.265也是屬於破壞性幀間壓縮,但是它在品質與壓縮的效果上取得了更高效益,處理過程,會對畫面進行更大或更小的分割比對。H.264是固定以16×16作為一組比對前後幀,而H.265則是最小8×8~最大64×64的像素區塊來比較,把流量分配得更精準,將流量花費在更複雜的變動區域中。

簡單的說:更好的畫質,更小的檔案,這個就是h265的優勢。在一些實際測試中,要達到相同的畫質,h265可能只需要h264的一半流量甚至不到。

H.265效益那麼好,為什麼不全部改h265就好? 聰明的各位應該不難猜到:H.265處理過程中「費工」許多,分析影像的過程得投入比H.264還要更費工的算力才能完成編碼。

拍攝時可能沒有什麼特別感覺,相機的處理器也都夠強。但一旦到了電腦,軟體要反向進行解碼時,如果沒有特定的硬體加速,電腦效能又普普,恐怕連播放都會有點卡頓,這就是為什麼現在很多人還是會選擇H.264的原因,檔案交給別人時較不容易會有這些問題。

當然,像現在蘋果的處理器有特別針對這一塊在優化,未來PC的效能也只會更高,一旦市場上的電腦都可以流暢支援編輯和播放時,自然就會正式取代H.264。

幀內壓縮:ALL-I

前面不管是H.264還是265,都是幀間壓縮,多個幀共用同一幀的部份資訊,用以達到壓縮的效果。

那像是Canon的新手一定都會看到影片格式有一個”ALL-I”的選項,在SONY的機器上則是”XAVC S-I”,兩邊的I指的都是”Intraframe”,也就是「幀內壓縮」。ALL-I通常也是使H.264,但壓縮編碼方式不同:處理時全部都是獨立幀、互不相干。

而幀內壓縮的代價就是檔案超大,所以才能夠完整保存每一幀的像素,如果拍攝主題是水花或是米粒,那你到電腦上定格畫面時,就可以察覺到品質比起幀間壓縮好很多,因為沒有偷工減料。

預設情況下我們不會去用這個格式,因為超肥,4K的ALL-I動輒就是兩三百Mbps起跳。除非今天是畫質優先,才會切過去。反過來說,如果今天只是要拍街訪或坐談,用ALL-I就是跟自己的口袋過不去,用前面說的IPB方式,效果其實不會差太多。

ALL-I在播放或編輯時,理論上會較輕鬆,因為不用像幀間壓縮不斷的演算前後幀。有些人還是會覺得播起來更卡,那通常是因為硬碟吞吐速度不夠,檔案雖然不用經過複雜的解碼,資料量卻十分龐大,硬碟速度不夠時就會有「電腦慢」的錯覺。

編碼器之三:影像工作者必用的ProRes

對於大部份相機來說,機內錄製的最高品質就是ALL-I。不過有些設備,不一定比較貴、但定位卻較專業,比如BMPCC或是GH6,還會有專為影像工作者設計的格式,也就是:Apple ProRes。

ProRes是由蘋果所開發的格式,一樣也是採用獨立的幀內壓縮,所以編解碼不需複雜演算,雖然該特性與All-I類似,但在定位上和H.264/H.265完全不同,主要用途為影像工作使用,並不會出現在一般大眾的生活中。也就是說你拍的時候、剪的時候用ProRes,但最後給業主的成片不會用這個格式,除非它是廣告電影公司或是電視台。

攝影新手不太可能一開始就買到有這種格式的相機,因為只會出現在相對高階的設備。一旦有此格式,我們都還蠻喜歡使用的,因為有利於後製,尤其是在mac上,讀取速度快、品質也很不錯。

那拍攝用的ProRes也有分為許多等級,差別在於壓縮率,品質從高至低:422 HQ→422→422 LT→Proxy,通常422就可以有理想的結果,真的要求更高品質就會選擇HQ,而不管選擇哪種等級,都是採用422的採樣搭配10-bit的色彩深度。

以我自身為例,不管今天拍攝回來的是H.265、H264甚至是ALL-I的素材,一律都會將它轉成ProRes Proxy才開始剪接。對於原生支援的Mac來說,ProRes剪起來可說是行雲流水。

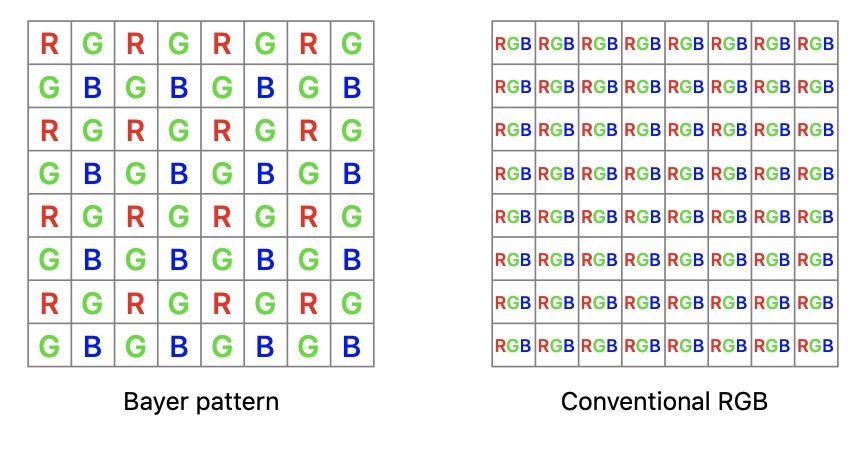

編碼器之四:元數據作業流程的ProRes RAW

這幾年Apple也推出了ProRes Raw的格式,算是Apple為了RAW作業提供的另一種方案,雖然在效能上表現也不錯,但最大目的在於保存最完整的原始感光數據,儲存的不是像素色彩,而是晶體的感測數據,到了電腦上才轉換成可視圖像。

現階段,最大的問題還是在於支援度,像是很多人使用的達芬其,目前還無法支援ProRes RAW,這個牽涉到大公司之間的利糾葛,有興趣的可以參考這一篇。

另一個問題是,它雖然號稱保留的是RAW原始數據,但還是有經過某種壓縮的程序,所以也需要一定的效能,而目前還沒有設備可以內錄這種格式,皆需要仰賴外部的擷取器才能以ProRes RAW儲存,對於只想拿裸機拍攝的人來說會較麻煩,還得再加購外置的專用設備,如Atomos Ninja+。

冷知識:MP3不是MPEG-3

最後來個冷知識:MPEG-3去哪了? 森編問:「是不是成為了後來的MP3?」其實不是。

MP3音訊格式,其實是第一代MPEG就有的壓縮格式(MPEG-1 Layer 3),也一路普遍到現在,畢竟聲音本數據量不大,不需要不斷精進的編碼技術。而MPEG-3影像編碼器呢,確實有推出過,主要目的是為了對應初期的HD電視格式的規格,但因為沒有大幅的改良,所以直接被加強版的MPEG2編碼器給併掉了,畢竟要產業跟進,必須得有革命性的進步。 就像是當時的H.264或是現在的H.265。而當時的MPEG-2十分強大,就是DVD標準所採用的編解碼器,後來緊接著統一了市場的就是MPEG-4,進而延伸為後來的H.264,所以.mp4檔名的由來就是MPEG-4。

说得好!!

謝謝杰克~ 看了你許多文章,讓我對於影片攝影的相關知識了解許多!!